又到了一年一度毕业季,本该是青春终章的谢幕,却被一个意料之外的新名词搅得人仰马翻——AIGC检测率。

如果你还不知道这是什么,那恭喜你,离上交论文还远。但如果你正处在修改第N稿、精神濒临崩溃边缘,那你大概率已经体验过它的“温柔一刀”——不是检测你抄没抄,而是判断你“写得像不像AI”。

而最讽刺的是,这个判断……也是AI来做的。

是的,现在的AI既要写,又要查,还要判断自己写的像不像自己写的。整套流程闭环到令人发笑,也让人不禁怀疑,这到底是科研的进步,还是形式主义的“科技孪生”?

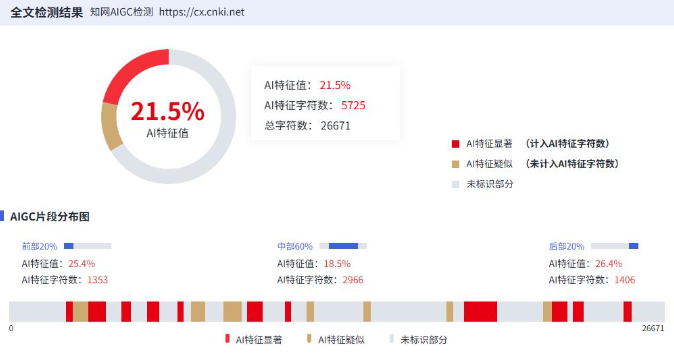

一开始大家对这个“检测项”并不当回事,直到送审前系统给出那一串冷冰冰的百分比——“你这段话有87.8%的可能是AI生成”——瞬间打懵了所有自信满满的毕业生。

问题是,有时候写得越专业、越逻辑清晰,反而越容易被判定为AI生成。这就有点魔幻了:

1、有人用自己两个月码出来的实验报告,被检测成AI;

2、有人往系统里扔了段《滕王阁序》,疑似率飙到99.2%;

3、还有人论文人工写的,导师帮忙改了几句,疑似度反而更高了。

这就像是在“鼓励”学生把论文写得像朋友圈长文、像热搜小作文,逻辑不能太清晰、词句不能太工整、语气不能太自然。因为这样就不“像人”了。

更搞笑的是,这种所谓的检测准确率压根没法保证。连OpenAI自家的AI检测器也承认准确率只有可怜的26%左右,有些时候甚至连莎士比亚都能误伤。

那检测工具是怎么做判断的?本质就是把文本的语言特征(用词、句式、结构等)拿去和AI模型训练库对比,判断“这段话像不像是AI写的”。

可当你训练AI时用的是人类写的文章,结果现在又反过来用AI来判断“你写得像不像AI”——这不是AI自己玩自己吗?

本来就是你学我,现在又说我像你?这锅我真不背。

更关键的问题是:论文到底应该检测什么?

教育部对毕业设计的定义是:要体现学生综合运用知识、独立分析和解决问题的能力。换句话说,它更关心你是否真正参与了研究,是否能站得住脚。

AI参与写作,从来不是问题的核心。问题是:你是否理解你写的内容?你是否真的搞懂了实验的原理与数据的逻辑?你是否花了时间,而不是 Ctrl+C/V 一通乱拼?

如果只是把AI当作一种排版、润色、整合工具,本质上不过是现代写作流程的一环,正如Office、Excel、Grammarly、EndNote也都是工具,为什么唯独AI成了“禁忌”?

讽刺的是,科研圈其实早已在广泛应用AI工具来辅助写作、翻译、文献总结,甚至自动实验分析。许多研究机构都在探索如何将AIGC深度融入科研流程中。

而学生这边,却仿佛被要求回到打字机时代,一个字一个字抠出来才“算数”。

这中间的割裂,不是学生不愿意努力,而是系统不给人信任。

这种基于概率、无法解释、不透明的检测,最怕的就是被当作“决策标准”。它不是黑白判断,而是一种浮动的模煳值——今天97%,明天85%,换个工具可能只有60%。就这,还要学生花钱去第三方网站自测自救,一个论文查重的产业链已经够卷,现在再加一条“AI疑似度检测链”,简直让人无力。

更不幸的是,这些检测平台往往一条龙服务,从AI写作、查重、降重、降AI、洗稿全包……结果是:想毕业,你得先“破财免灾”。

是防AI,还是防学生用AI?还是说,其实我们只是在防“快速出成果”的捷径?

如果一篇论文是AI写的,但内容合格、数据合理、结构清晰,难道就该一票否决?

反过来,如果全篇靠人工拼凑,内容空洞、逻辑混乱,疑似率再低,又有何意义?

我们是否应该放下“AI痕迹”这根指挥棒,回归对论文最本质的审查——内容质量、数据真实性与论证能力?

在这个AI全面渗透生活、工作与教育的时代,我们终究无法阻止学生使用工具。唯一该阻止的,是把一个辅助工具妖魔化、把一种语言风格标签化、把一种写作方式机械化。

让我们不要变成“更像AI”的人,只是为了躲避“写得像AI”的AI检测。

毕业不是筛选“写得不像AI”的人,而是评估那些真正努力学会了如何思考、表达与解决问题的学生。

所以,是时候扔掉那根“疑似率”的标尺了。

百度热点

百度热点

抖音热榜

抖音热榜

新浪微博

新浪微博

今日头条

今日头条

腾讯新闻

腾讯新闻

知乎热搜

知乎热搜

36氪

36氪

雪球网

雪球网